Stable Diffusion 3 yrittää estää nakukuvien luomisen – nyt se johti suorastaan kauhistuttaviin tuloksiin

Kuva: Pixabay / darksouls1

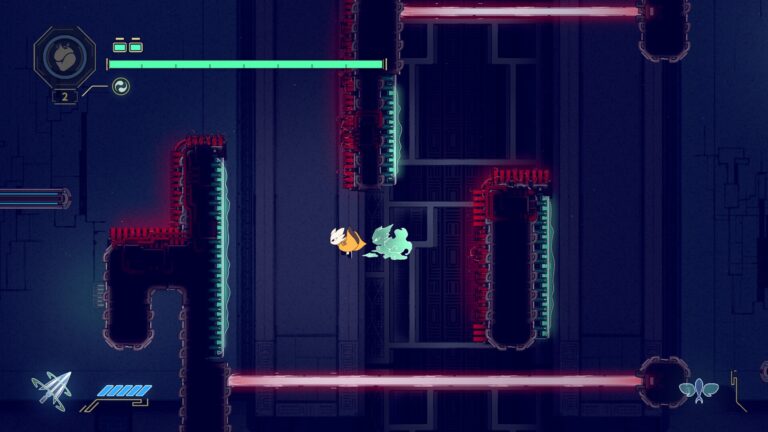

Generatiiviseen tekoälyyn perustuvassa Stable Diffusion 3 Medium -kuvanluontimallissa on suodatin, jonka pitäisi estää alastonkuvien luominen. Se toimii, mutta ”body horror” -elokuvien tyyppisesti.

Stability AI julkaisi version, jonka tuloksia on pilkattu pitkin verkkoa. Päivityksen myötä käyttäjää saa ihasteltavakseen tavallisen ihmiskehon sijaan erilaisia, kauhuelokuvamaisia kammotuksia.

Redditissä on ihmetelty, miksi on niin vaikeaa ”luoda kuva tytöstä nurmikolla”, ja päivitystä on myös epäilty vitsiksi. Mallilla vaikuttaa olevan vaikeuksia erityisesti ihmisen raajojen suhteen.

Stability AI on saanut pilkkaa osakseen.

– Ei ole kovinkaan kauan siitä, kun Stable Diffusion kilpaili Midjourneyn kanssa, mutta nyt se näyttää vain vitsiltä siihen verrattuna. Ainakin meidän datasettimme ovat turvallisia ja eettisiä, kirjoitti eräs Reddit-käyttäjä.

SD3 Mediumin kauhukuvien on arveltu johtuvan nakukuvien suodattamisesta. Alla muutama kuva.

Stable Diffusion 3 AI Makes Eldritch Body Horror Abominations // Contraten fotógrafos y listo 🤣 https://t.co/tgVIqQ8eNT

— Space Invȁ̜͉̱̙̰͚̌͐̄ͦ̋der (@Spac3_Invad3r) June 13, 2024

"I guess now they can go bankrupt in a safe and ethically [sic] way, after all." -from ArsTechnica. I like the quote – it is what every AI company who aims of complete Politically Correct outcomes deserves. I still use Stable Diffusion 1.5, it is superior. https://t.co/EXVXRMwE54 pic.twitter.com/2DiXoOnwt2

— Hogne Titlestad (@autocaret) June 13, 2024